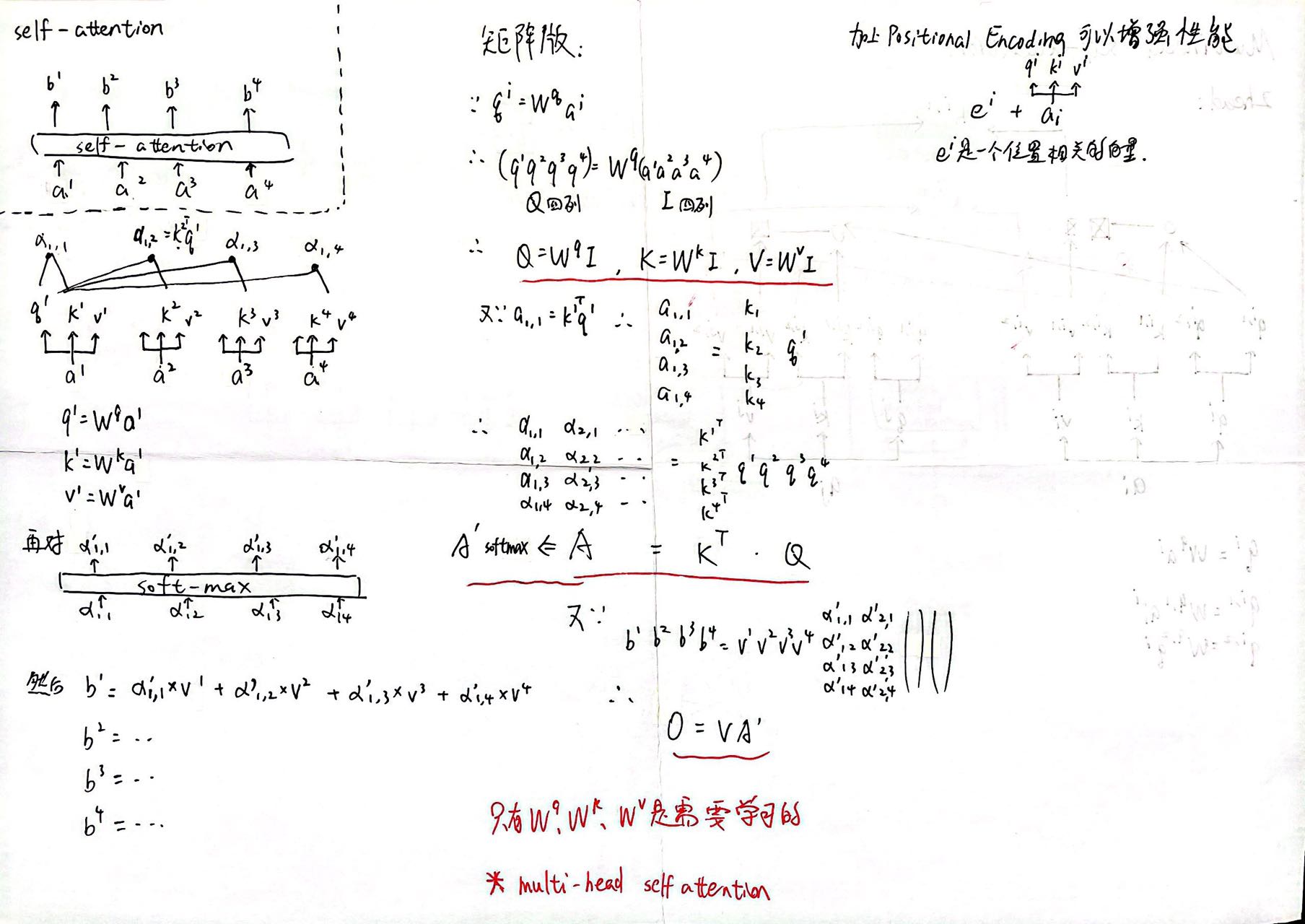

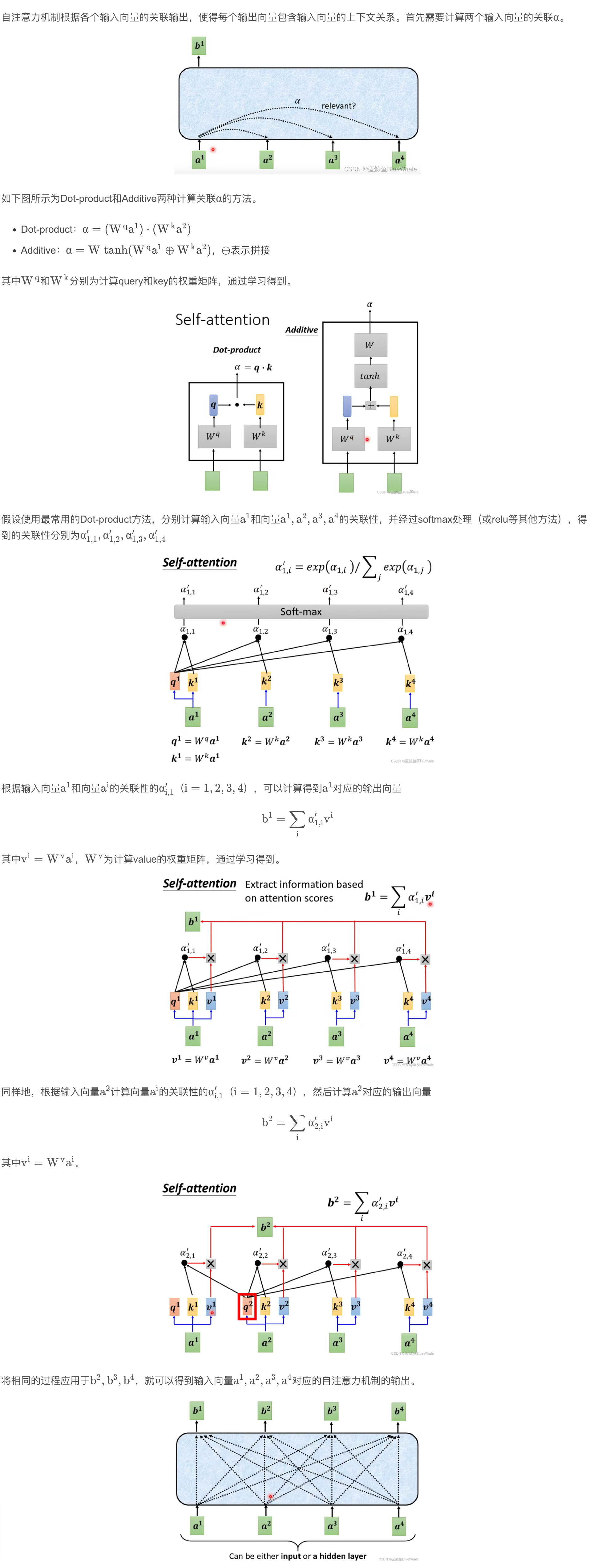

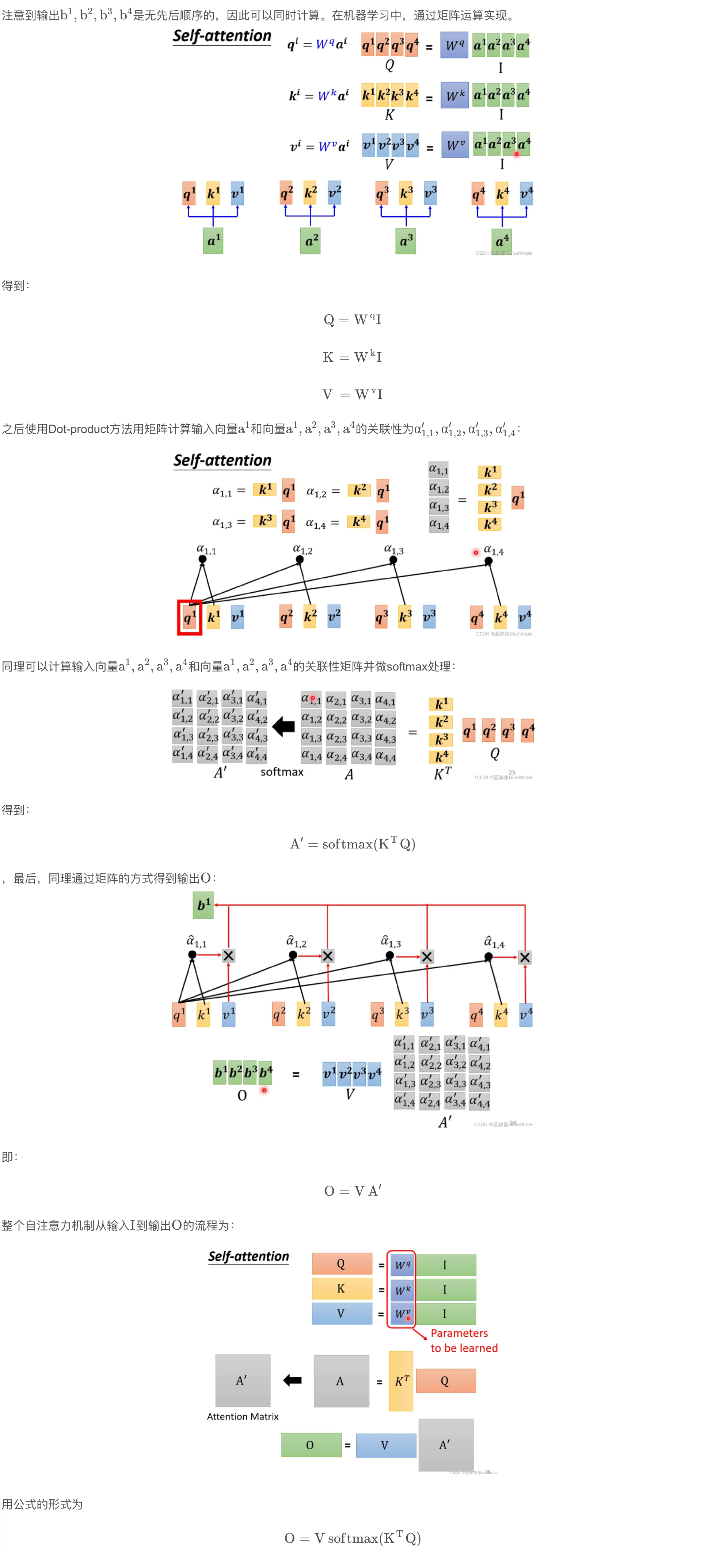

Self Attention

概览

细节

矩阵运算

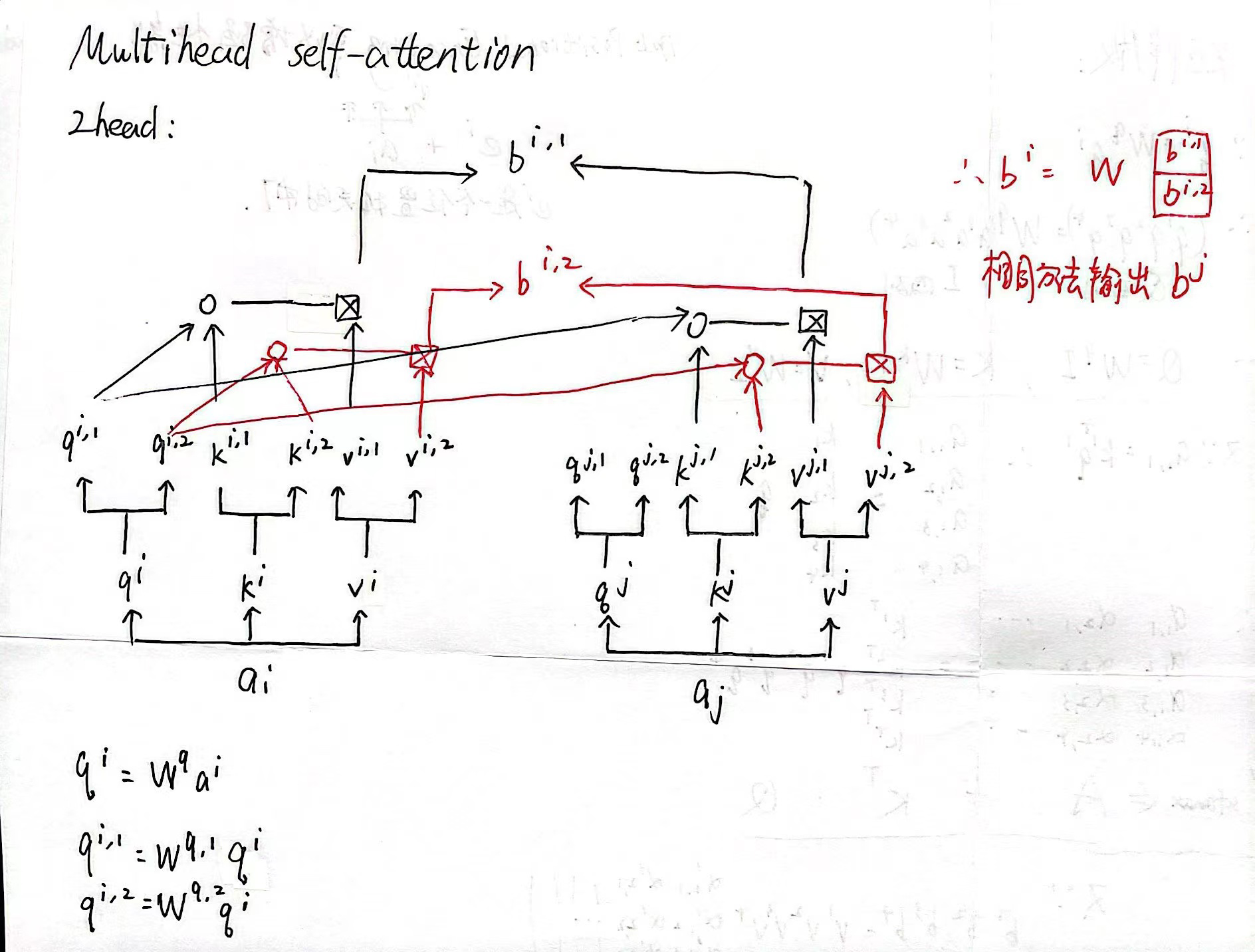

Muiltihead Self Attention

概览

细节

- 这里的 a i 和 a j 是同一个输入(可以理解为下图的X)

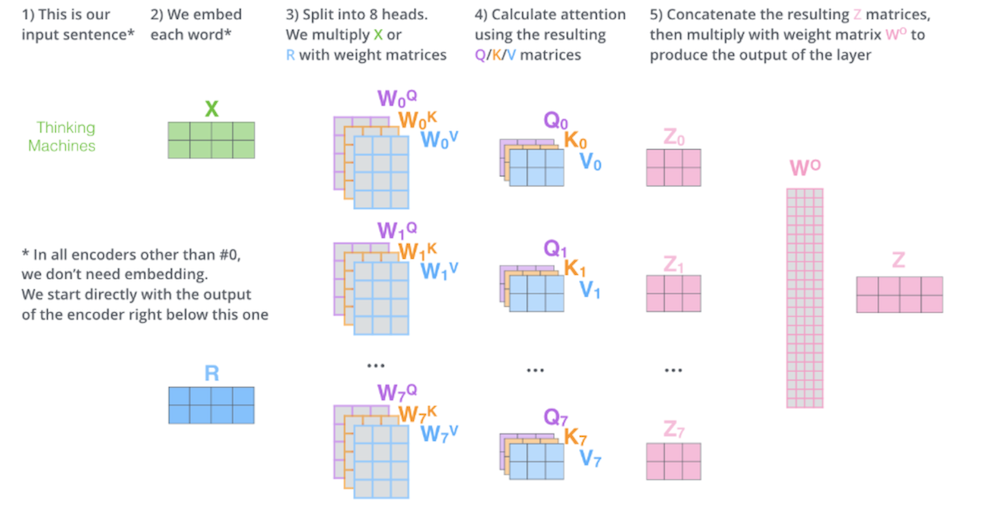

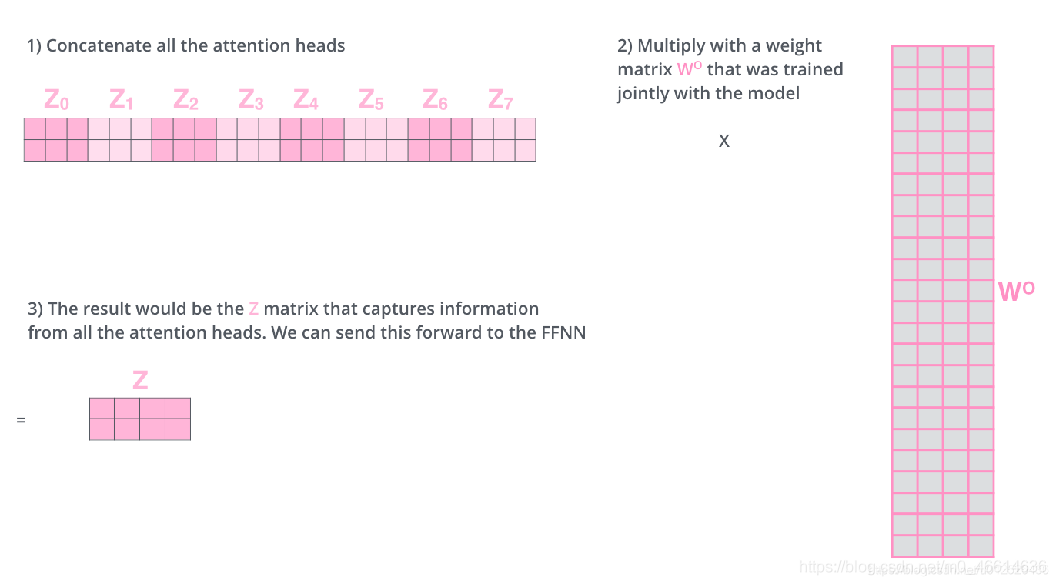

完整过程

八个头相当于八个不同的表征子空间,类似于apple拥有水果的含义,同时也有商标的含义,不同的含义由不同的表征子空间学习。

让其他词的Q来和apple这个词不同组的K-V进行attention。

再把所有的attention结果拼接起来,通过一个全连接层(矩阵变换)得到最终结果。

X是一开始经过Embedding的词向量矩阵,R为之前层输出的,他俩都可以进行Multihead Self Attention